面對多元AI 應用快速落地所帶來的效能挑戰、資料主權與營運成本壓力,企業正積極尋求更穩定、可控且具經濟效益的地端部署方案。

QNAP 威聯通推出推出 Edge AI 存儲解決方案,打造一站式邊緣運算平臺,整合資料儲存、虛擬化、GPU 加速與系統資源管理,協助企業建構支持AI 數據儲存、模型推論、智慧制造與影像分析等多元應用場景的地端AI 運算架構,同時降低傳統云端部署常見的資安風險與授權成本。

QNAP Edge AI 存儲服務器支持靈活運行虛擬機與容器化應用,可部署私有大型語言模型(LLM)與各類AI解決方案,廣泛應用于智慧辦公、智能制造、零售與安防監控等領域。

人工智能時代企業面臨的挑戰

隨著 GenAI、LLM 與邊緣計算需求激增,傳統 IT 架構正面臨五大瓶頸:

1. 云端風險高

超九成企業將數據安全列為 AI 部署首要考量。云部署易受數據泄露與合規風險威脅。

2. 成本壓力大

模型調用、令牌計費、GPU 資源、存儲與虛擬化平臺等堆疊授權費用不斷推高總體擁有成本(TCO)。

3. 系統架構分散

計算與存儲脫節,導致集成復雜、維護繁瑣,降低整體效能。

4. 性能不穩定

共享資源環境下,AI 模型與虛擬應用競爭算力,引發延遲與性能波動。

5. 數據爆炸增長

AI 與數據密集型應用持續產生海量數據,挑戰傳統存儲的擴展性與管理能力。

QNAP Edge AI 的好處

QNAP Edge AI 存儲服務器提供統一的邊緣計算平臺,整合數據存儲、虛擬化、GPU/I/O 加速與 CPU 資源管理,助力企業高效部署本地 AI 應用與邊緣設備。

支持多樣化的邊緣 AI 應用場景,包括:

· 小型語言模型(SLM)推理

· 大型語言模型(LLM)推理

· 生成式 AI 應用(GenAI)

· AI 模型的推理與微調

· 智能制造與工業自動化

· 智能零售與客戶行為分析

· 智能監控與視頻內容識別

QNAP Edge AI 核心優勢

QNAP Edge AI 存儲服務器提供靈活的系統資源分配、先進的硬件加速和企業級數據保護,使其成為邊緣計算的理想平臺。

· 強化資安與合規性

AI / LLM 模型與敏感數據可在地端 NAS 中本地存儲與運行,避免經由云端傳輸,降低資安風險,滿足法規要求。特別適用于金融、醫療、制造等高度重視數據主權的行業。

· 整合式架構,降低TCO

集成存儲、虛擬化、GPU 加速與數據保護于一體,簡化建置流程,減少多平臺整合負擔,有效降低長期運維成本。

· 精準掌控運算資源

支持 GPU 與 PCIe Passthrough、SR-IOV 網絡資源優化與即將推出的 CPU 核心隔離,資源配置更靈活,虛擬機運行效能接近原生,保障低延遲與高穩定性。

· 虛擬化與容器部署更靈活

支持在 QNAP NAS 上安裝虛擬機和容器,快速部署多種 AI 應用環境,適用于模型部署、智能開發與虛擬備份服務器等場景。

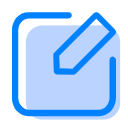

· 快速導入開源 LLM

搭配 Ollama,可輕松部署如 LLaMA、DeepSeek、Qwen、Gemma 等主流開源語言模型,打造企業知識庫、智能客服或 AI 工具,加速落地、降低導入門檻。

在 QNAP NAS 上無縫運行本地 LLM

在一個設備上集成虛擬化、大型語言模型 (LLM) 和直觀的 UI:

滿足不同業務需求的

多功能應用程序

· 企業 AI 知識中心

結合 NAS 存儲、大型語言模型(LLM) 與 RAG 技術,打造本地 AI 驅動的智能搜索系統,全面提升企業的數據檢索效率、洞察分析能力與生產力。

· 人工智能聊天機器人

借助 大型語言模型(LLM) 驅動,實現更快速、精準的響應,顯著提升客戶互動體驗與參與度。

· 虛擬化服務器

支持運行多個虛擬機,靈活構建企業內部 AI 模型的開發與測試環境。

· 虛擬機備份和數據保護

集成 Veeam 備份解決方案,提供高可靠的虛擬機數據保護,全面提升業務連續性與數據安全性。

· AI數據存儲與備份

可用于存儲原始 AI 數據集,或作為 RAG 架構中頻繁訪問數據的高速存儲節點,助力構建高效穩定的 AI 工作流。

來源:QNAP威聯通企業存儲

資訊頻道

資訊頻道